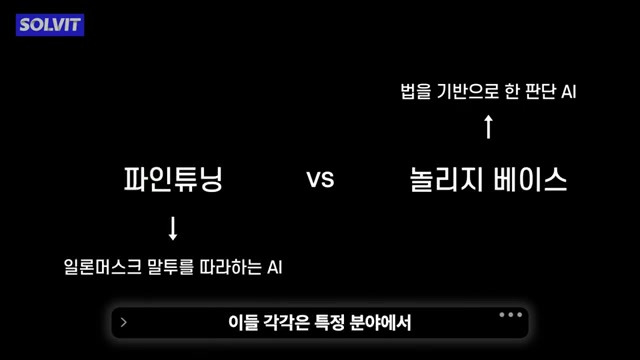

AI에게도 공부를 시키는 전략들이 LLM과 함께 대표적으로 2가지가 대두되었다.

파인튜닝과 그라운딩.

맞춤형 LLM으로 개발하는 방식이고

sLM, sLLM 과 연결되는 개념들이다.

근데 무슨 소리냐고?

파인튜닝, 그라운딩, RAG, LoRA.. 어렵다 어려워!

좀더 쉽게 알려주는 사람은 없을까?

.

.

.

챗봇 딥러닝 - 초거대모델의 파인튜닝 방법 - P-tuning과 LoRA

BERT 이후로 딥러닝 자연어처리는 사전훈련 모델(pre-trained model)이 기본이 되었습니다. 보통 위키피디아 같은 데이터로 사전훈련을 하면 언어의 기본적인 특징을 이해하게 됩니다. 그다음 개별 태

aidev.co.kr

찾았다!

https://www.youtube.com/watch?v=SKFHCdkrqUA

[파인튜닝]

어록 학습과 벡터 데이터베이스 활용파인튜닝 방법은 거대 언어 모델을 미세조정하여 사람을 디지털화할 때 효과적

최근에는 철학자들의 책을 학습시켜 심리상담 형태의 GPT 서비스가 등장한다.

일론 머스크와 유시민과 같은 유명 인사들의 어록을 학습하여 사람의 언어 스타일을 모사할 수 있다.

[Knowledge Base]

반면, 벡터 데이터베이스를 활용하면 상상이 아닌 정보 기반 응답이 가능하다.

작년에 출시된 OpenAI GPT-3 기술은 벡터 데이터베이스 활용을 강조하며, 강력한 정보 기반 답변 가능하다.

그라운딩, RAG 기술 총체

핵심 내용 정리

1. GPT 모델 활용을 위해 파인튜닝과 벡터 데이터베이스 결합이 중요하다.

2. 파인튜닝은 언어 모델을 미세조정하여 특정 도메인에 적합한 결과를 얻는 방법이다.

3. 벡터 데이터베이스를 활용하면 상상 이상의 정보 기반 응답이 가능하며, OpenAI GPT-3에서 강조되었다.

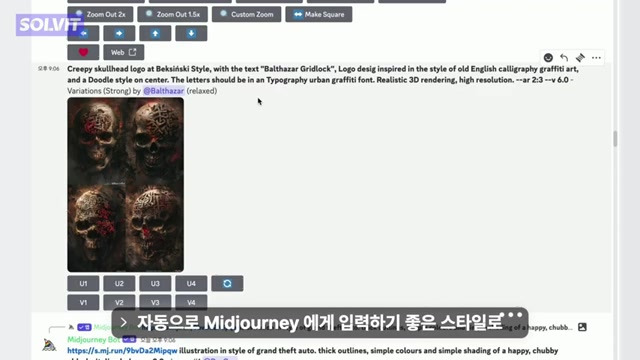

4. 글쓰기에 이미지를 추가하기 위해 미드져니(져니 ㅎㅇ) 기술을 활용하는 중요성이 부각되고 있다.

5. 미드저니를 사용하면 일정한 스타일의 이미지를 생성하며, 글쓰기 방식에 새로운 변화를 가져올 수 있다.

6. 이를 통해 글과 이미지의 조화가 이루어지며, 글쓰기 환경이 보다 다양해질 수 있다.

7. 모델 재학습을 통한 해결방법이 텍스트 러닝보다 우수하다.

8. 구체적인 프롬프트 준비와 비용 부담을 줄이며, 파인튜닝은 정확도 면에서도 뛰어나다.

9. 모델 재학습은 프롬프트 넣는 방법보다 효율적이며, 해결하려는 문제에 적합한 접근 방식이다.

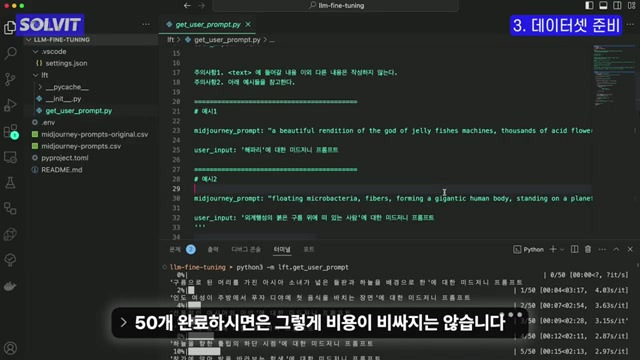

10. 데이터셋 다운로드와 수집은 GPT 모델 학습에 필수적이다.

11. '허깅 페이스'나 '캐글' 등의 사이트를 활용해 데이터셋을 다운로드 받을 수 있으며, 학습 데이터의 품질이 중요하다.

12. 50개의 프롬프트를 수집하고 적합한 데이터셋을 선택함으로써, 모델의 학습 효율성이 높아진다.

13. GPT를 효과적으로 활용하기 위해 모델링 파인튜닝과 로라 학습이 필요하다.

14. 데이터셋 생성과 모델 파인튜닝을 효율적으로 진행하여 모델 적용을 완료하고, 로라를 활용해 전체 모델을 향상시킬 수 있다.

15. 다양한 방법론과 도구를 적용하면 높은 품질의 결과물을 얻을 수 있으며, 관심 있는 분야에서 활용성을 높일 수 있다.

[상세 내용 정리]

1. GPT 활용을 위한 두 가지 방법

- 많은 사람들이 특정 도메인에서 GPT를 활용하려고 시도하고 있다.

- 그러나 기존의 GPT를 그대로 사용하면 만족스러운 결과를 얻기 힘들다.

- 첫 번째 방법은 파인튜닝으로, 개인적인 데이터로 언어 모델을 재학습시킨다.

- 두 번째 방법은 Knowledge Base로, 지식을 벡터 데이터베이스 형태로 변환하여 언어 모델이 참조하도록 한다.

- 각각의 방법은 특정 분야에서 서로 다른 강점을 발휘한다.

2. 🔍어록 학습과 벡터 데이터베이스 활용

- 파인튜닝 방법은 거대 언어 모델을 미세조정하여 사람을 디지털화할 때 효과적이며,

- 최근에는 철학자들의 책을 학습시켜 심리상담 형태의 GPT 서비스가 등장하고 있다.

- 일론 머스크와 유시민과 같은 유명 인사들의 어록을 학습하여 사람의 언어 스타일을 모사할 수 있다.

- 반면, 벡터 데이터베이스를 활용하면 상상이 아닌 정보 기반 응답이 가능하다.

- 작년에 출시된 OpenAI GPT-3 기술은 벡터 데이터베이스 활용을 강조하며, 강력한 정보 기반 답변 가능하다.

- 이번에는 모델 재학습을 통해 글에 맞는 이미지 프롬프트 생성하는 GPT 모델을 소개하고, 텍스트로부터 이미지 생성을 가능케 한다.

3. 📸글과 이미지의 조화

- 미드저니를 활용한 글쓰기.

- 글 쓰기에 이미지 삽입이 중요하다고 느껴 글 사이에 이미지를 추가하고 싶을 경우 미드저니를 적절하게 사용하면 된다.

- 그림은 직접 찾거나 생성 AI 기술을 활용해 삽입하며, 미드저니 사용시 일정한 스타일의 프롬프트 입력이 필요하다.

- 미드저니를 사용하면 다른 사용자들이 비슷한 이미지를 생성하는 것을 알게 되었으며, 이는 글쓰기 방식에 일정한 변화를 가져올 수 있다.

- 글 쓰는 데 집중하고 싶어 미드저니에 적합한 스타일로 글을 자동 변환하는 필요성을 느낌.

4. 🧠모델 해결방법

- 파인튜닝이 프롬프트 넣는 방법보다 우세

- 모델 일부를 재학습시켜 문제를 해결함.

- 프롬프트에 예시를 많이 넣어 미드저니 프롬프트 생성하는 '텍스트 러닝' 방법 -> 대안 존재.

- 파인튜닝이 우세한 이유:

- 1) 구체적인 프롬프트 준비가 귀찮음.

- 2) 비용 증가: 모델이 처리해야 하는 토큰 수 증가, 더 큰 모델 운용 위해 추가 비용 필요.

- 3) 정확도 차이: 모델 재학습 방식이 정확도 면에서 우수함.

5. 💻모델링 파인튜닝과 모델 다운로드 과정 설명

- 파인튜닝을 위해 가장 적합한 모델을 선택하고, GPU 연결, 모델 다운로드를 위한 권한 있는 토큰을 가져와야 한다.

- 모델을 양자화하여 불러오고 실행하여 적합성을 테스트한다. 실행 결과 맥락 이해 능력을 확인한다

- 데이터를 준비해야 하는데, '허깅 페이스'나 '캐글' 등의 사이트에서 데이터셋을 다운로드 받을 수 있다.

- AI 허브를 통해 정부가 제공하는 데이터셋을 활용할 수도 있다.

- 연구 목적으로 50개의 프롬프트를 수집하고, 전형적인 형식을 따른 데이터셋을 생성하였다.

- 학습을 위해 미드저니 프롬프트에 대응되는 자연어 프롬프트를 필요로 하며, 이를 위해 적합한 데이터셋을 선택하였다.

6. 🤖GPT-4를 사용하여 유저 인풋을 생성

- GPT를 활용하여 유저 인풋을 얻기 위한 작업 프로세스를 설명함.

- 프롬프트로부터 유저 인풋을 생성하고 GPT에게 사용자 입력을 추론하도록 지시하며, 불필요한 내용은 포함하지 않도록 안내.

- CSV 파일을 읽어 GPT-4를 호출하여 유저 인풋에 결과를 작성하는 코드 실행과정을 설명함.

7. 🔗구글 스프레드시트를 활용한 CSV 파일 저장 및 GPT-4 모델 활용

- 구글 스프레드시트에 작성한 내용을 CSV 파일로 다운로드하여 저장할 수 있으며, 이를 위해 GPT-4 모델을 활용했다.

- 라이브러리들을 설치한 후에 스크립트를 실행하여 CSV 파일 내용을 분석하고 결과물을 확인할 수 있다.

- 파이썬 프로젝트 정의 방식으로 적절한 파일을 만들어 필요한 라이브러리들을 설치하고 스크립트를 실행할 수 있다.

- GPT 리턴 결과물이 유저 인풋 컬럼에 저장되며, 이를 통해 50개의 작업을 완료하면 추가 비용이 발생하지 않는다.

8. 💻데이터셋 완성부터 언어 모델 적용,로라 학습까지

- API 콜은 몇 백 원대로 가능하며, 데이터셋 생성은 약 3분 소요되었다.

- 미드저니 프롬프트와 가짜 유저 인풋 파일을 이용해 데이터셋을 처리하고, Google Colab에 파일을 로드한다.

- 언어 모델을 적용한 후, 로라를 사용하여 전체 모델을 다시 학습시키지 않고 파인 튜닝을 빠르게 진행하는 것이 효율적이다.

- 로라 외에도 유사한 방법론이 존재하므로, 관심 있는 분들은 참고해보기를 권유한다.

9. 🤖로라 모델 파인튜닝 프로세스와 결과 확인

- 로라는 트랜스포머의 특정 레이어에 붙어 파인 튜닝하는 테크닉이며, 해당 모델들은 로라 모듈이 붙을 수 있는 레이어를 찾는다.

- 스크립트는 이 레이어들을 찾아내는 것으로, 로라 컨피그에 해당 모듈들의 이름을 추가해 적용할 수 있고, 학습 후 테스트까지 진행된다.

- 결과물은 백스텝 학습을 통해 쓸 만하며, GPT 아웃풋 사용 시 조금의 정제로 더 나은 결과물을 얻을 수 있다.

- 모델을 Hugging Face 레지스트리에 푸시하여 공유할 수 있으며, 어떻게 활용할지 댓글을 통해 의견 공유를 요청하는 내용이 소개된다.

- 끗 -

다음 회차에는 RAG에 대해서 알아보자!